Algorithm[53]

单目相机像素坐标系到世界坐标系的转换

世界坐标系->像素坐标系 转换过程可参见这篇文章:FunnyWii's Zone 机器视觉 - 单目相机入门 ,其中描述了世界坐标系->像素坐标系的转换过程。可以归结为下述公式: 世界坐标系->像素坐标系的过程描述的是单目相机的成像原理。我们在使用单目相机的过程中,更关心的往往是像素坐标系->世界坐

我还在学CUDA编程(四)——内存的层次结构

CUDA 内存模型 存储器的类型有两种: 可编程:显式控制哪些数据存放 不可编程:不能决定数据存储位置 在CPU层次结构中,一级缓存(L1 Cache)和二级缓存(L2 Cache)都是不可编程的。可编程的存储器类型包括: 寄存器 共享内存 本地内存 常量内存 纹理内存 全局内存 下图为上面提到的存

继续学CUDA编程(三) —— CUDA执行模型(下)

并行归约问题 先解释一下什么是归约(Reduction),归约是将某个计算问题变换为另一个问题的过程。在CUDA运算中,在向量中执行满足交换律和结合律的运算,被称为归约问题。每次迭代计算方式都是相同的(归),从一组多个数据最后得到一个数(约)^[1]^。比如当给定N个数值,求其SUM/MAX/MIN

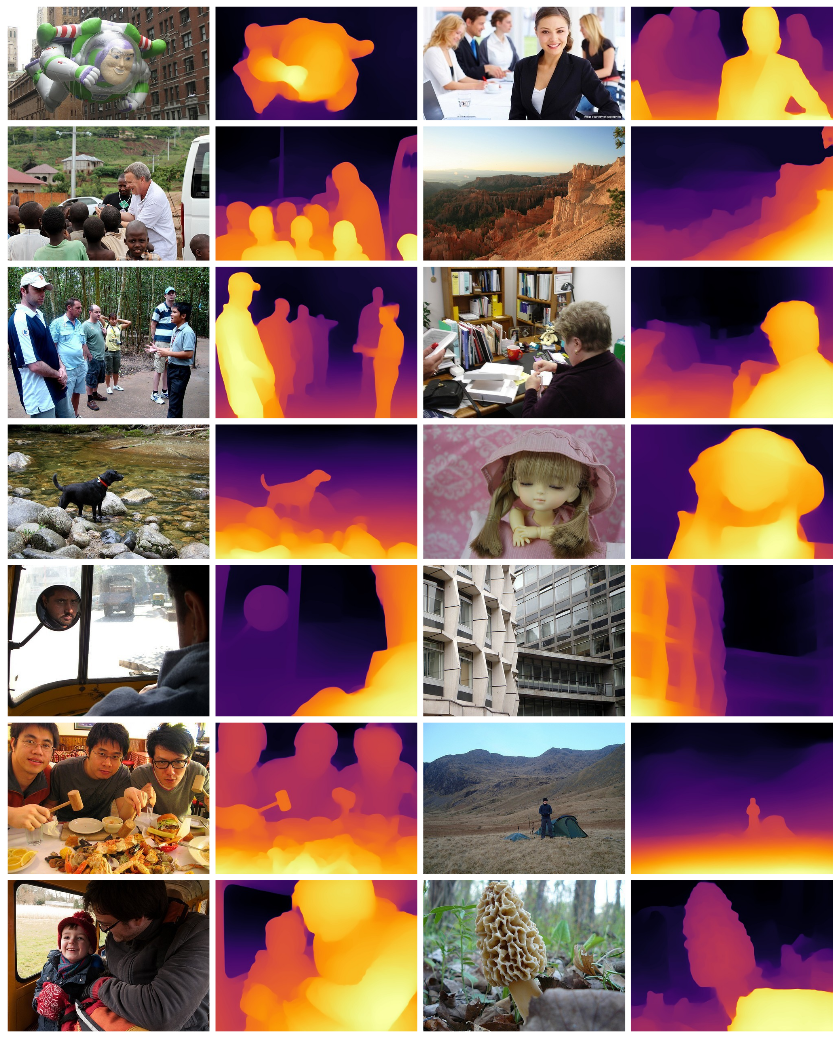

单目相机的深度图,以及绝对深度和相对深度

深度图 深度图 (Depth Image, Depth Map),将图像中的每个像素都编码为相机到场景中某个点的距离,可以提供图像中物体的空间信息。深度图通过坐标转换可以转换为点云数据,organized点云也可以转换为深度图数据。 绝对深度和相对深度 绝对深度:空间中物体和相机间的距离,有量纲。

同一个窗口显示多个相机图像(多线程方法)

主要是依靠 copyTo()方法实现图像的传递。 copyTo 内存分配:当源图像和目标图像 size和 type一致时,不会分配新内存;否则先申请新内存空间再拷贝 目标图像:可以将数据复制到指定的目标图像中,目标图像可以是已经存在的图像或者新图像。 MASK:通过MASK可以指定ROI clone

继续学CUDA编程(三)——CUDA执行模型(上)

这一部分是CUDA的核心部分,涉及到了硬件和程序的执行模型。 SM 流式多处理器(Stream Multi-processor,SM)是构建整个GPU的核心模块。GPU的硬件并行,是通过复制了多个SM来实现的。一个Block只能在一个SM上被调度。 下图包含了SM的关键组件 CUDA核心 (Core

“我还要学CUDA编程!”(二)——CUDA编程模型

CUDA编程结构 在GPU上执行的函数称为CUDA核函数(Kernel Function),核函数会被GPU上多个线程执行。典型的CUDA程序遵循如下模式: 把数据从CPU内存(HOST)拷贝至GPU内存(DEVICE) 调用该Kernel函数,对DEVICE中的数据进行操作 将数据从DEVICE传

”我要学CUDA编程!“ —— 来自一个废物的自白

写在前面(废话,请跳过) 本来自己的脑子里是不存在CUDA编程这个东西的,没错,就是压根儿没听说过。 之所以了解到这个东西,是因为最近开始做AVM (Around View Monitor),或者说SVS (Surrounding View System),利用4个广角相机,实现车辆周围的360°环

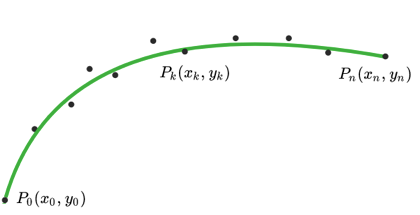

车道线的多项式曲线拟合

离散点平滑 基于优化的离散点平滑 模型检测到的车道线,最终的输出的是车道线的点坐标(x,y),这些点能够大概描述车道线在画面中的位置,但是如果想要拟合出车道线的高阶方程,可能还是不够平滑,一些离散点会影响拟合的效果。 优化变量:车道线点坐标(x_i,y_i) 优化目标有三个,分别是平滑度、长度和相对

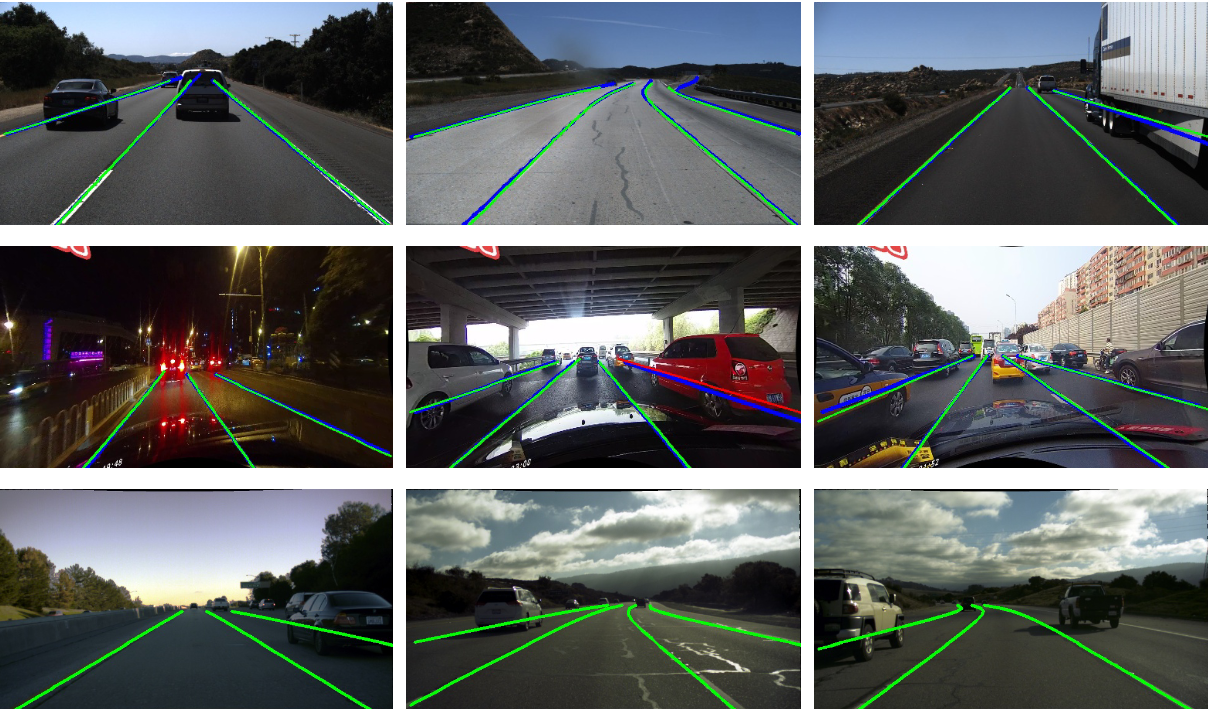

车道线检测功能综述【深度学习方法】

深度学习方法 车道线检测常用数据集见 FunnyWii's Zone 车道线检测功能综述【传统方法】 基于分割的方法 利用语义分割或实例分割方法来区分图像中的车道线与其他物体或背景。这种方法将车道线检测问题转化为一个像素级分类问题。这种方法会将场景图片的每一个车道线像素都进行分类,判断该像素是否属于