编程 [39]

可变参数模板和折叠表达式的工程示例

多传感器融合算法往往都需要一个时间同步算法,时间同步算法的输入一般是多个带时间戳的传感器数据。 使用C++不久的人,往往会给这多个传感器的类分别创建实例,在处理的时候再根据传感器数量进行遍历。这样写没有问题,就是不够优雅。 学习可变参数模板和折叠表达式需要先对C++中的Template有一定了解。模

C++模板

C++是一门强类型语言,编写一个通用函数,能把任意类型的变量传进去处理,通过把通用逻辑设计为模板来摆脱类型限制 C++中的模板语法,实际上是在为C++提供泛型(Generic Programming)的机制。 最常见的泛型应用在STL的容器中。 类模板 Class Templates用于生成类。 没

C++11及其之后的新特性(简单介绍)

C++11 自动类型推导 auto需要注意的是: 必须在定义时初始化auto类型的变量 auto类型不能定义数组 一旦初始初始化,就不可更改类型 auto x = 5;

auto y = 3.14;

auto a; // 错误

auto array[10]; //错误

auto a = 10;

ROS1的launch文件

之前一直是 rosrun方式启动ros节点的, 一是因为懒, 二是因为我只负责一个节点, 用不到launch方式. 这次遇到了不能保存ROS日志的bug, 换成launch方式启动就能成功保存日志了... Launch文件 ROS中 .launch 文件可以同时启动多个 node, 包括 rosco

ROS1的bag录制

bag录制 录制所有话题,这里没有指定bag名,会在当前路径生成一个当前时间戳命名的bag rosbag record -a 录制指定话题 rosbag record <topic_name1> <topic_name2> ... 录制指定话题,并指定bag名称,arg为大写的英文字母O rosba

C++ STL容器的底层原理

C++ STL 容器是使用频率超高的基础设施,只有了解各个容器的底层原理,才能得心应手地用好不同的容器,做到用最合适的容器干最合适的事情[1]。看了文章[1],可惜其中对容器方法的底层几乎没有提及,那就自己边查边写吧。本文大部分内容来自cplusplus.com/reference/ 。 C++ S

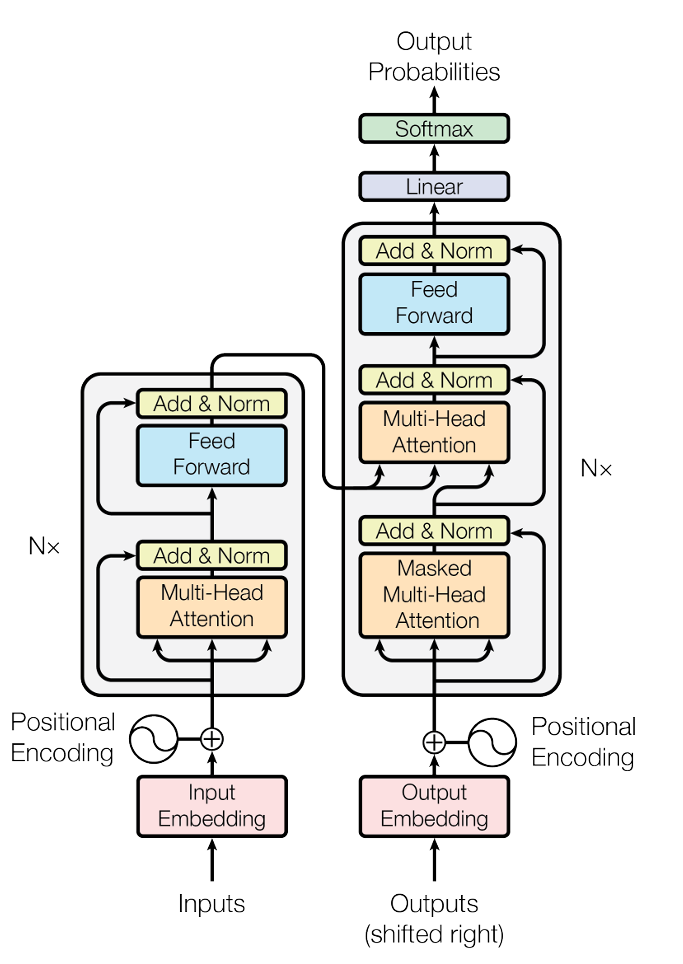

学习Transformer

Transformer在谷歌2017年的论文 [1706.03762] Attention Is All You Need 中首次被提出,主要用于NLP(Natuarl Language Processing,自然语言处理)的各项任务。 后来在CV领域,研究者们基于Transformer架构开展了一

ROS2的消息发布和订阅&图像发布和订阅

ROS2的编译 colcon 是 ROS2 编译的工具。ROS2 的工作空间与 ROS1 保持一样的目录结构: <workspace>

├── build # 编译时自动生成,包含编译的中间文件

├── install # 编译时自动生成,包含编译的结果:可执行文件,库文件,

Ubuntu安装ROS2,以及与ROS1的共存

系统环境:Ubuntu 20.04 ROS2版本:Foxy,其中Foxy是LTS长期支持版本,Galactic不是,但是这两者都只能运行在Ubuntu20.04上。 ROS2的安装 先检查是否支持UTF-8,用locale命令 jetson@funnywii-orin:~$ locale

LANG=

道路目标流量统计算法

实现流量统计算法有两个前提: 能够实现目标检测,最基本的前提,必须能够识别到视频帧中的车辆和行人。 能够进行目标跟踪,在检测的基础上,为目标分配一个唯一的ID。流量计数依赖于目标的唯一ID。 目标检测算法以YOLO系列为例。 跟踪算法以ByteTrack跟踪结果为例。将检测结果objects作为By

我还在学CUDA编程(四)——内存管理及访问模式

内存管理 内存分配和释放 CUDA编程模型存在HOST和DEVICE两个异构系统,每个异构系统都有独立的内存空间。 在HOST上,可以使用下面语句分配全局内存: cudaError_t cudaMalloc(void ** devPtr,size_t count) 要注意的是第一个参数,是指针的指针

相机视频流的编码格式

VideoWriter 类 最近几个项目都需要保存相机图像数据,也就是存成视频。有的要求保存源视频,有的要求保存处理后的视频。 由于图像数据的读取是使用 OpenCV,目标检测框架也是建立在OpenCV的基础上,所以保存图像顺理成章也使用OpenCV。使用 OpenCV 的 VideoWriter

我还在学CUDA编程(四)——内存的层次结构

CUDA 内存模型 存储器的类型有两种: 可编程:显式控制哪些数据存放 不可编程:不能决定数据存储位置 在CPU层次结构中,一级缓存(L1 Cache)和二级缓存(L2 Cache)都是不可编程的。可编程的存储器类型包括: 寄存器 共享内存 本地内存 常量内存 纹理内存 全局内存 下图为上面提到的存

OpenCV 的 remap() 函数中的 map1 和 map2

今天在 StackOverflow 上看到这么个问题:想把原图像中的一个点 g,通过内参和畸变参数映射到去畸变图像中的点 p,并获取这个点的坐标。 你以为我接下来会说:“xxx和我想的一样,但是我想错了,其实并不是这样....” 现在,我想说的只有“其实并不是这样”,因为我连map1和map2是啥我

继续学CUDA编程(三) —— CUDA执行模型(下)

并行归约问题 先解释一下什么是归约(Reduction),归约是将某个计算问题变换为另一个问题的过程。在CUDA运算中,在向量中执行满足交换律和结合律的运算,被称为归约问题。每次迭代计算方式都是相同的(归),从一组多个数据最后得到一个数(约)^[1]^。比如当给定N个数值,求其SUM/MAX/MIN

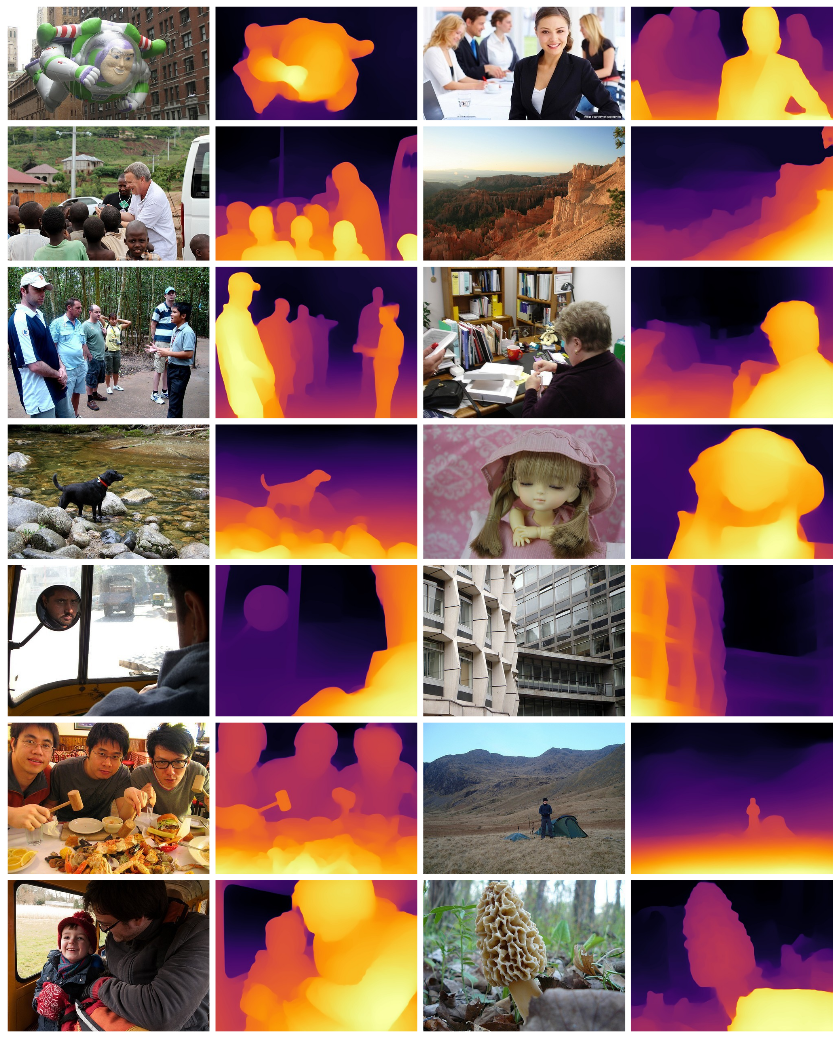

单目相机的深度图,以及绝对深度和相对深度

深度图 深度图 (Depth Image, Depth Map),将图像中的每个像素都编码为相机到场景中某个点的距离,可以提供图像中物体的空间信息。深度图通过坐标转换可以转换为点云数据,organized点云也可以转换为深度图数据。 绝对深度和相对深度 绝对深度:空间中物体和相机间的距离,有量纲。

同一个窗口显示多个相机图像(多线程方法)

主要是依靠 copyTo()方法实现图像的传递。 copyTo 内存分配:当源图像和目标图像 size和 type一致时,不会分配新内存;否则先申请新内存空间再拷贝 目标图像:可以将数据复制到指定的目标图像中,目标图像可以是已经存在的图像或者新图像。 MASK:通过MASK可以指定ROI clone

使用Python控制海康球头相机运动的方法

控制海康球头的3种方法 做了一些调查,目前控制海康相机的方法主要有三种 海康SDK,目前海康提供了多个平台的SDK,包括Windows,X86Linux和ARM Linux(Jetson),见HiKSDK onvif,不过这个库是基于Python2做的,用起来会有些麻烦。 HTTP方式。 树莓派py

Jetson Orin部署Mediapipe Holistic检测

安装JDK Jetpack一般不带JDK,sudo apt install openjdk-11-jdk 装一个。 安装Bazel 针对Mediapipe这个项目,你需要使用的Bazel版本,取决于你下载的Mediapipe版本所使用的Bazel版本(有点绕,高可以,低不行)。 要问CMake能不能

继续学CUDA编程(三)——CUDA执行模型(上)

这一部分是CUDA的核心部分,涉及到了硬件和程序的执行模型。 SM 流式多处理器(Stream Multi-processor,SM)是构建整个GPU的核心模块。GPU的硬件并行,是通过复制了多个SM来实现的。一个Block只能在一个SM上被调度。 下图包含了SM的关键组件 CUDA核心 (Core