Machine Learning[10]

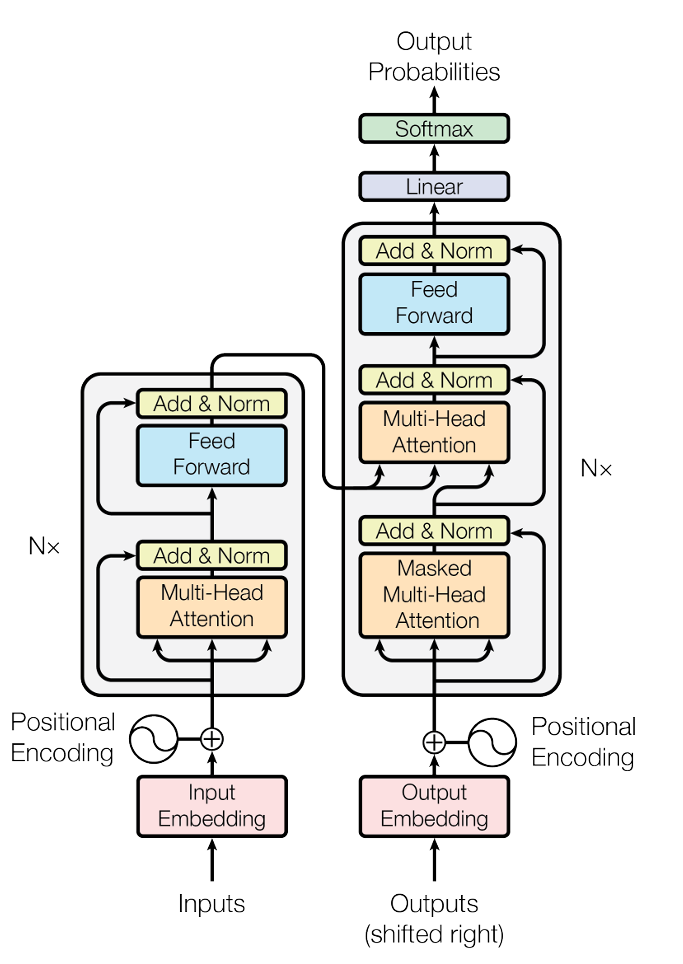

学习Transformer

Transformer在谷歌2017年的论文 [1706.03762] Attention Is All You Need 中首次被提出,主要用于NLP(Natuarl Language Processing,自然语言处理)的各项任务。 后来在CV领域,研究者们基于Transformer架构开展了一

机器学习 - 正则化和优化器(Regularisation and Optimisers)

当模型可调节参数(自由度)过多时,容易学习到训练数据中的噪声,进而出现 “过拟合”(训练集误差小、测试集误差大)。因此要对模型的参数引入某种限制,在训练过程中避免过拟合。。 正则化通过在损失函数中加入参数惩罚项,约束参数规模,迫使模型优先学习数据的通用规律,而非噪声。 范数 在正式进入正则化的学习之

机器学习- 感知机 Perception

Neural Networks, NN 1943年 Warren McCulloch 和 Walter Pitts 设计了人工神经网络(artificial neural network,ANN),通常简称为神经网络(NN)。ANN是受构成动物大脑的生物神经网络模糊启发的计算系统,但是每个神经元上的

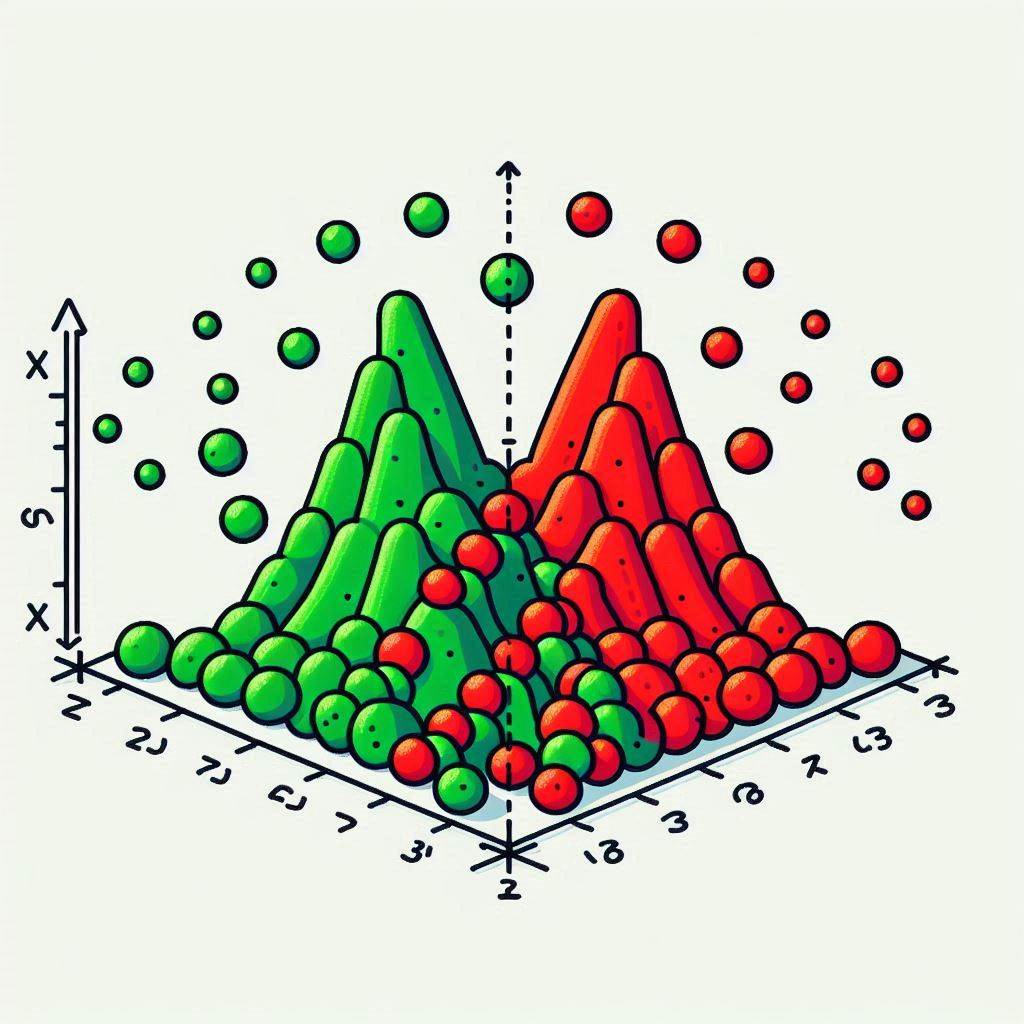

机器学习 - 分层聚类和Kmeans

聚类 聚类是一种无监督的机器学习方法,它能使类似的对象从其他对象中分离出来。它是无监督的,因为我们没有给模型任何标签;它只是检查特征并确定哪些样本是相似的并属于一个群组。 常见的聚类算法有: 分层聚类算法(Hierarchical Cluster Analysis HCA) k-Means Expe

机器学习 - 主成分分析(PCA)

主成分分析 获取到的数据集通常都会有很高的维度,给运算造成很大压力,所以需要降维,但是我们并不知道哪些数据更关键,因此引入了主成分分析 (Principal Component Analyses,PCA)的方法。PCA算法在无监督学习中扮演者重要的角色。 PCA的目的是通过某种变换,将数据的维度减小

机器学习 - 特征工程(Feature Engineering)

机器学习的建模流程 Figure 1 Pipeline of Machine Learning 研究问题 采集数据 数据清洗 在采集到的数据中,可能有丢失的,比如NaN或者null,这种数据是不能直接拿来用的。为了解决这个问题,这部分数据会被imputed,具体impute的方法要根据数据的类型来决

机器学习 - 决策树 (Decision Tree)

什么是决策树(Decision Trees) 对于决策树,目标变量是连续数值的,被称为回归树;若是离散值,被称为分类树。 比如,预测预测房价,是回归树;预测病患是否患病,是分类树。本文重点介绍分类树。 决策树是一种非参数化模型。 决策树的构造 · 根结点(Root node):代表整个数据集或采样,

机器学习 - 回归(Regression)

线性回归 顾名思义,线性回归问题中,输入和输出呈线性关系。 回归被用来估计或解释一个独立变量(y)和一个or更多独立变量(x_i)之间的关系。最基础的回归-线性回归-基于一个线性方程。 假设这个方程为: y = \theta_1 x+ \theta_0 此处 y 是一个独立变量,\theta_0 和

关于机器学习(Data Modelling and Machine Intelligence ACS61013)这门课

Data Modelling and Machine Intelligence (DMMI) 数据建模和机器智能 其实这门课就是在讲机器学习(Machine Learning),起个这么长的名字属实没必要。 这门课的老师是 Dr John Oyekan,是一名非常年轻的,刚刚入职没多久的,黑人讲师,

机器学习八股文 - 基础概念

什么是Overfitting 算法在训练集上表现好,但在测试集上表现不好,泛化性能差。 引起过拟合的原因 模型本身过于复杂,以至于拟合了训练样本集中的噪声。 如何解决过拟合 交叉验证。 用更多的数据进行训练。 数据增强。 特征选择。 Early Stop。 正则化 Regularization。 什