Deep Learning[30]

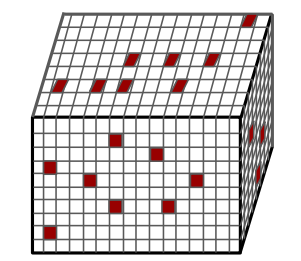

3D稀疏卷积 3D Sparse Convolution

点云数据体素化后,有90%+的Voxel是空的,如果像VoxelNet那样直接使用3D Conv,计算量太大。 左图是稀疏的2D Tensor,深灰色像素都是0,浅灰色是non-zero点。 右图是稀疏的3D Tensor,只有红色的体素才是non-zero。 因此提出了3D稀疏卷积——3D Spa

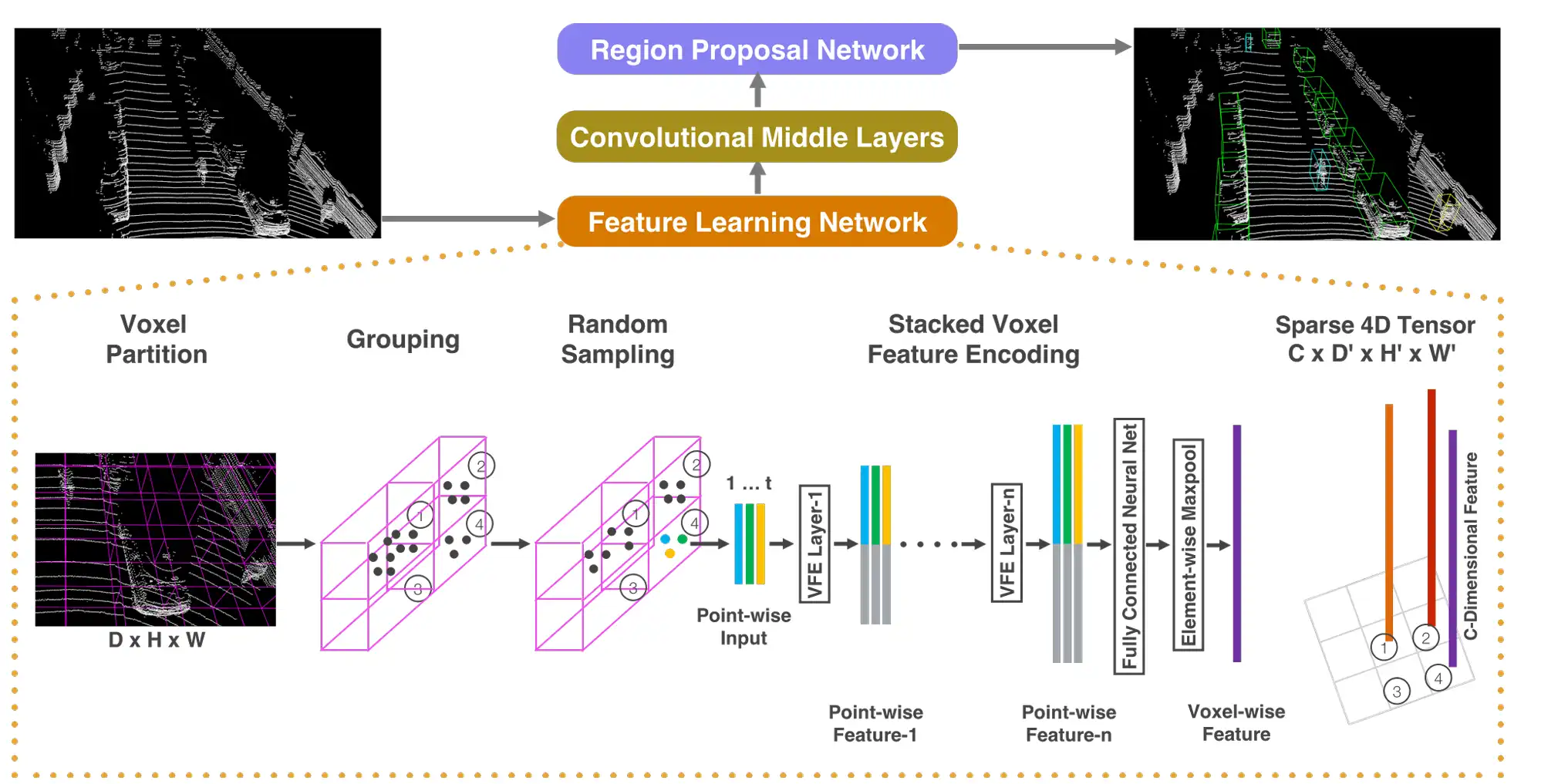

【重读经典】点云深度学习网络的范式变迁:PointNet, VoxelNet和PointPillars

PointNet 直接以 N×3N \times 3的Raw PointCloud作为输入,每个点使用 (x,

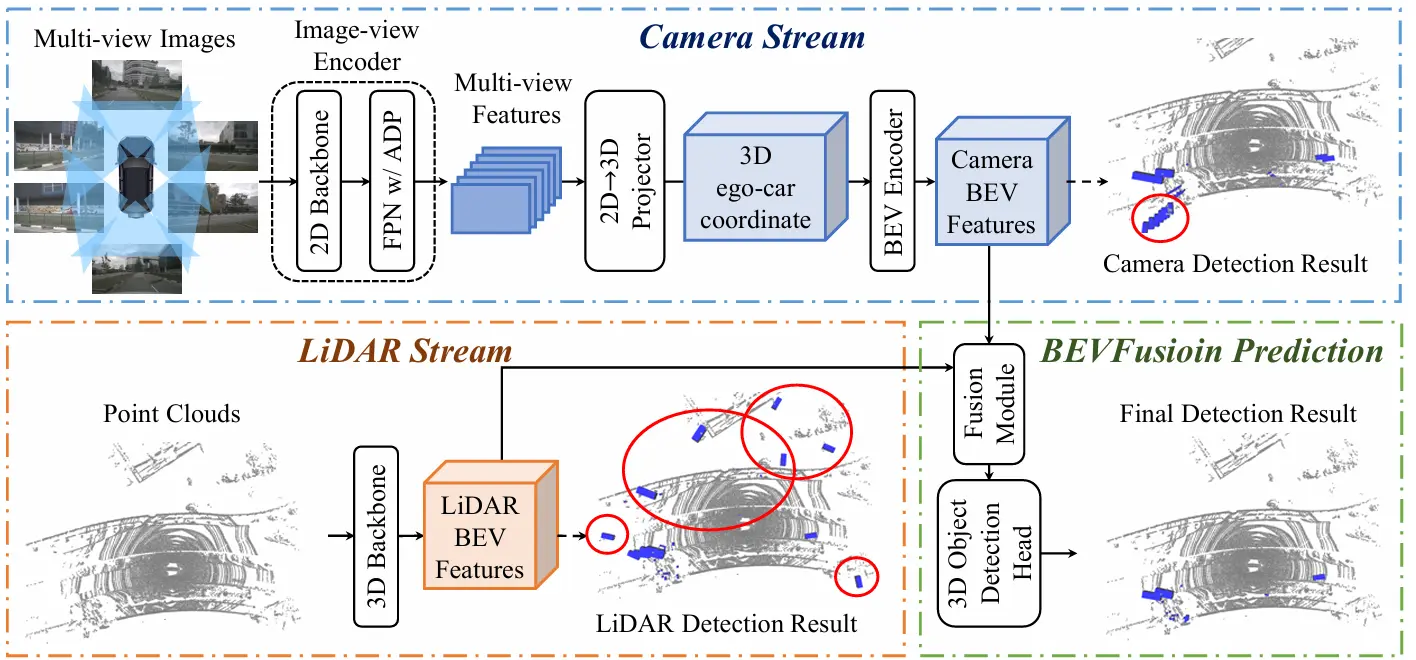

【重读经典】BEVFusion: A Simple and Robust LiDAR-Camera Fusion Framework

BEVFusion有两篇论文: 一篇名为《BEVFusion: A Simple and Robust LiDAR-Camera Fusion Framework》,发表于2022年。 另一篇名为《BEVFusion: Multi-Task Multi-Sensor Fusion with Unif

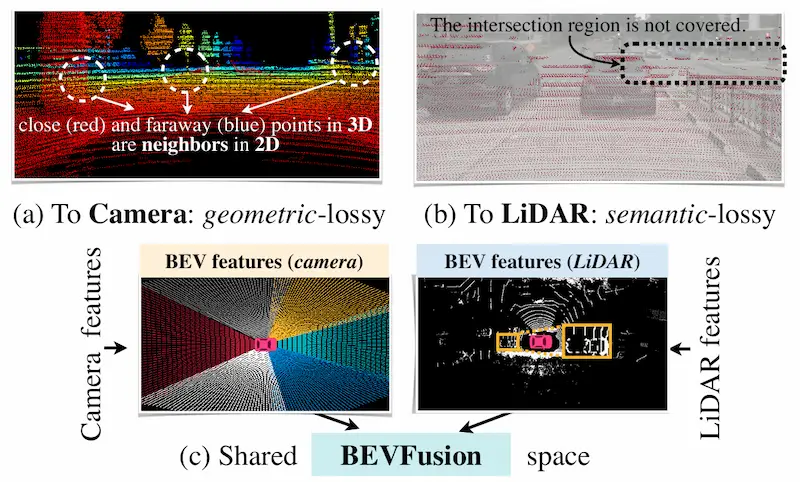

【重读经典】BEVFusion: Multi-Task Multi-Sensor Fusion with Unified Bird's-Eye View Representation

自动驾驶常见传感器包括相机,LiDAR,雷达等传感器。 相机能提供丰富语义,LiDAR提供准确的空间信息,雷达能进行速度估计。 对于多传感器方案,当时的传感器投影存在信息损失的问题: LiDAR->Cam:存在几何损失,像素坐标系中相邻的像素点,在3D空间中可能距离很远。设想一个人站在墙前面,在像素

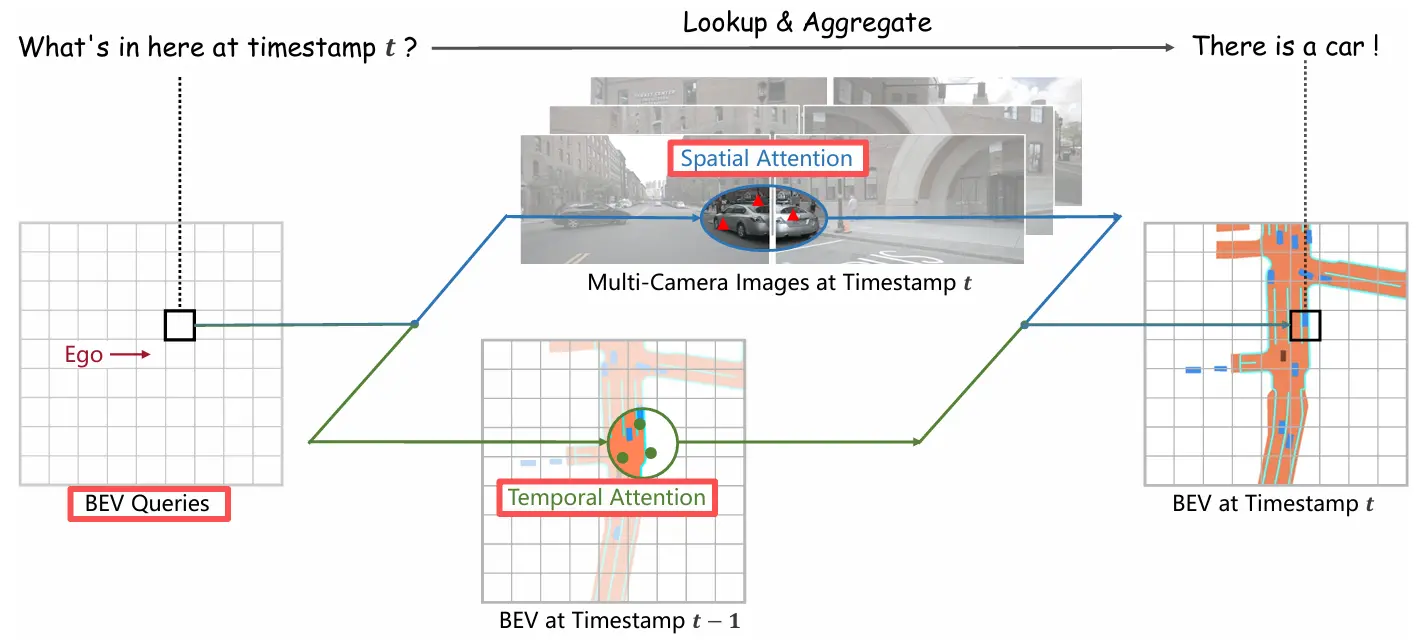

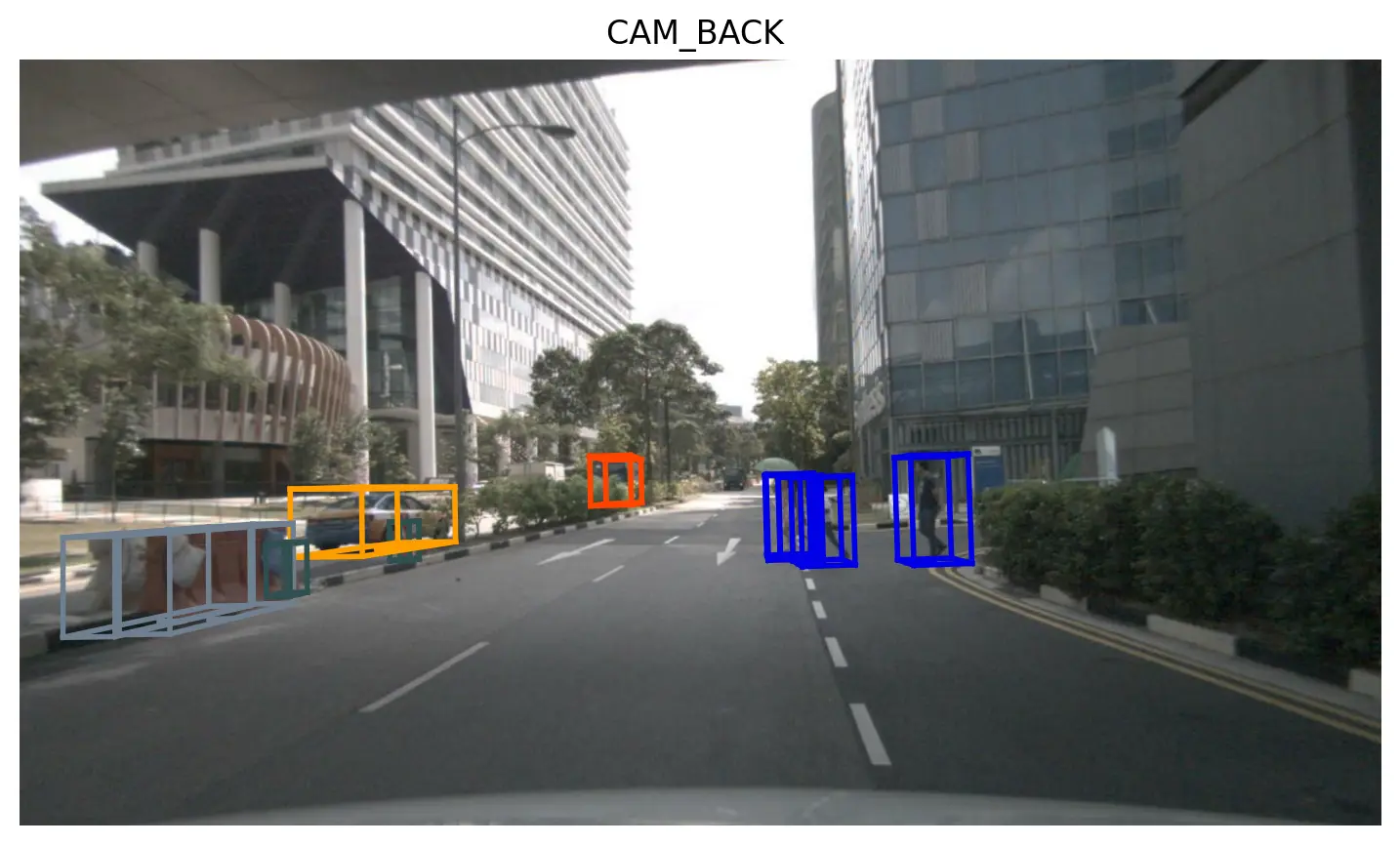

【重读经典】BEVFormer: Learning Bird's-Eye-View Representation from Multi-Camera Images via Spatiotemporal Transformers

先看论文题目 Multi-Camera:多相机纯视觉方案,Camera-based的mAP天然比LiDAR-based和Fusion-based的要低 Spatiotemporal:时间空间 Transformer:用到了Transformer架构以及Attention机制 创新点 论文摆脱了之前L

nuscenes-devkit的使用

nuScenes数据集说明 - FunnyWii's Zone 一文了解nuScenes数据集的结构。 我们使用nuscenes-devkit进一步学习数据集的使用。 安装非常简单,建议python版本3.12和3.9。 pip install nuscenes-devkit devkit使用 仍以

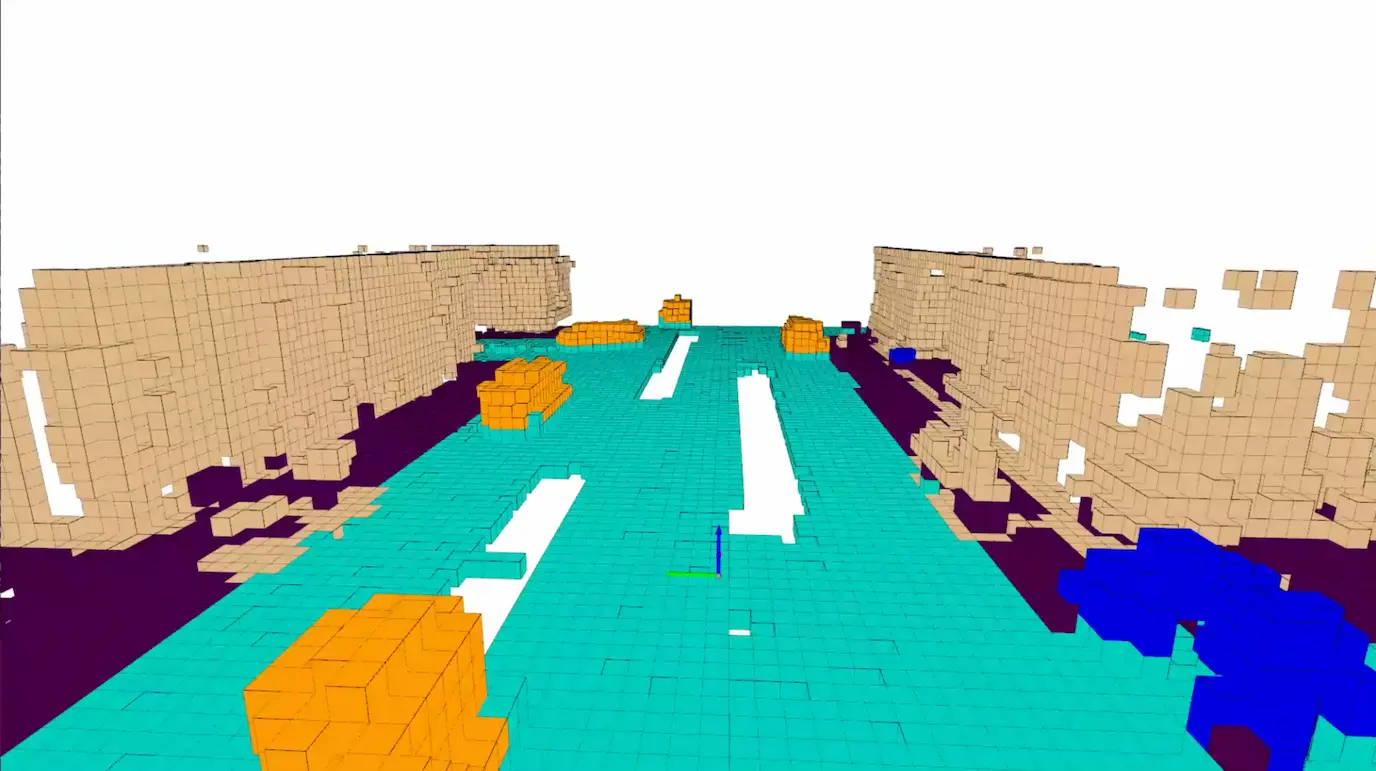

Ubuntu22部署FlashOcc踩坑实录

环境配置 conda create --name FlashOcc python=3.8.5

conda activate FlashOcc

pip install torch==1.10.0+cu111 torchvision==0.11.0+cu111 torchaudio==0.10.0 -f

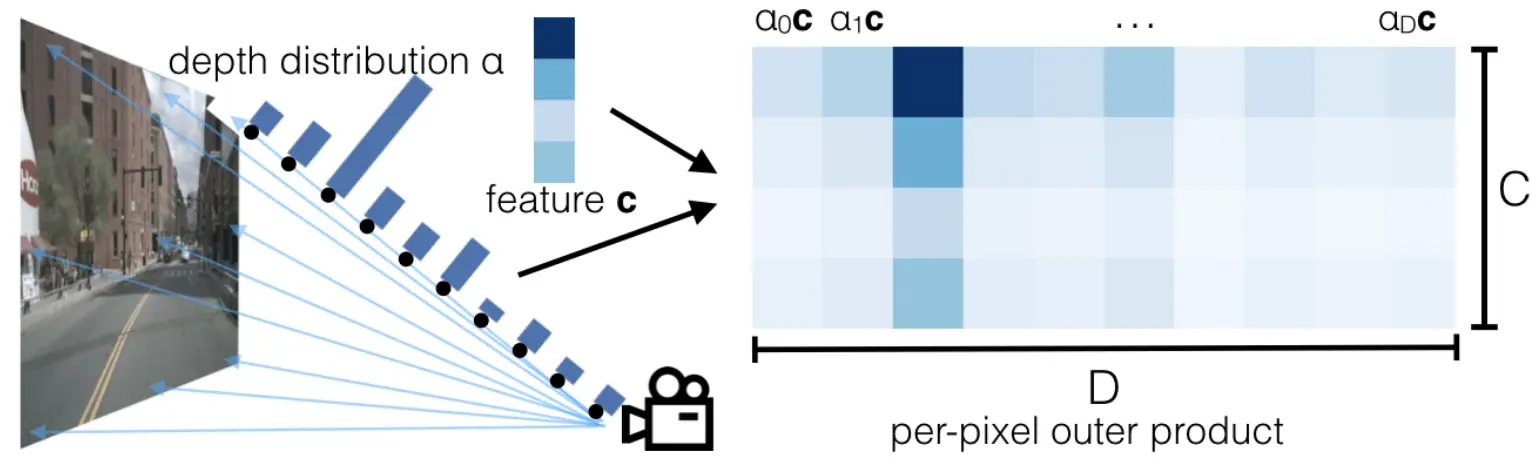

【重读经典】Lift, Splat, Shoot: Encoding Images From Arbitrary Camera Rigs by Implicitly Unprojecting to 3D

LSS是NVIDIA在ECCV2020上发表的文章。 理解一下论文标题中的Lift, Splat, Shoot三个单词。 这三个单词对应模型中三个核心步骤。 Lift:提升。2D图像特征提升到3D视锥空间特征。 Splat:泼溅。所有相机生成的3D视锥特征,泼洒到统一的BEV平面网格。 Shoot:

【重读经典】3D Bounding Box Estimation Using Deep Learning and Geometry

Deep3DBox是一篇比较早的使用单目相机进行3D目标检测和姿态估计的方法。 Deep3DBox先用CNN回归目标的方向和尺寸,因为这两类属性稳定性比较高。然后结合2D BBOX的几何约束求解平移量,以生成完整的3D BBOX。 有些传统的方法基于PnP,通过2D-3D关键点对应关系求解姿态,需要

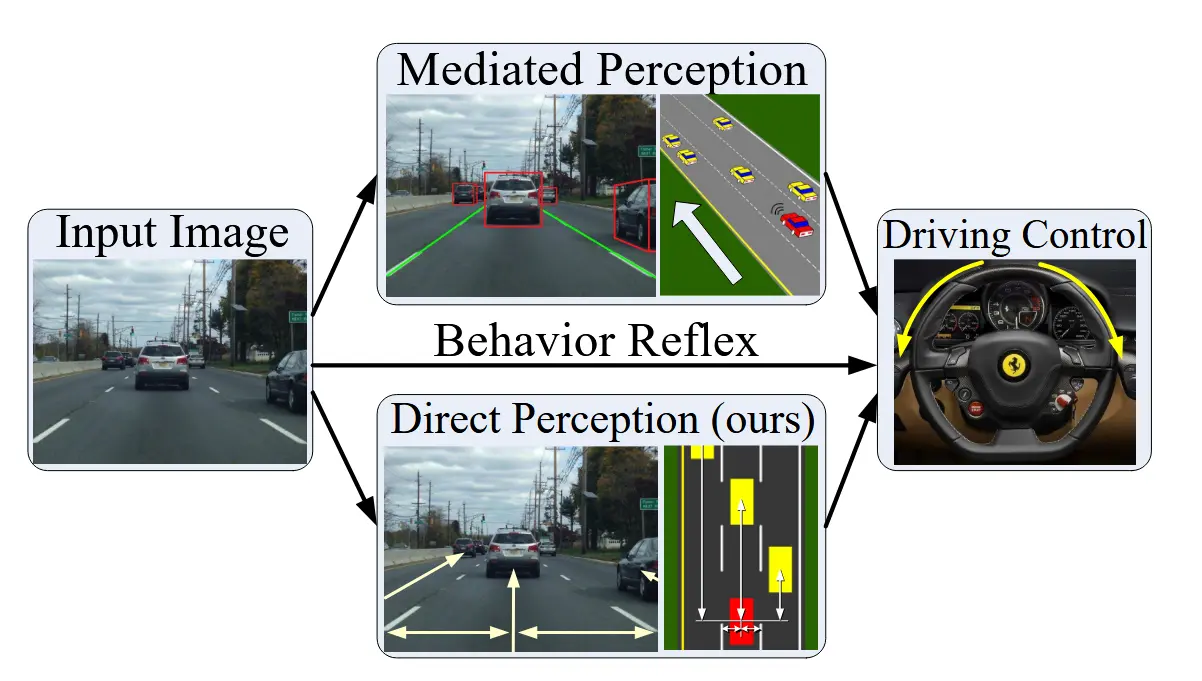

【重读经典】DeepDriving: Learning Affordance for Direct Perception in Autonomous Driving

标题中的Affordance一词,本意是”预设用途,功能特性“,最初在知觉心理学和设计学领域出现。 后来在人机交互领域,Affordance的含义变成了:一个产品让用户自然领悟到用法的能力。 在机器人领域(自动驾驶和机器人的感知不分家),被引申为可以执行的潜在动作,即在特定情况下哪些动作是可执行的。