Algorithm[53]

车道线检测功能综述【传统方法】

车道线检测技术 车道线检测技术是计算机视觉和自动驾驶领域中的关键技术之一,它能够帮助车辆在道路上准确识别和跟踪车道线,从而实现自动驾驶、车道保持等功能。 车道线检测方法总体上可以分为 传统方法 和 基于深度学习的方法。 车道线数据集 数据集 数量(张) 尺寸 场景 特点 TuSimple 72k 1

使用OpenCV的VideoCapture的实例化vector读取多个相机

写在前面 现在车上有7个相机,如果想要用OpenCV同时读取这些相机的画面的话,实例化7个 VideoCapture是没有问题的,虽然会涉及到多线程的问题,但是多线程我还不会(ciao,是反废话)。直接实例化多个 VideoCapture未免有些显得技术力过低,因此使用 vector容器来存放读取的

mmyolo目标检测之边用边学(笨鸟快飞边学边更版)

写在前面 为什么不直接输出一堆内容,主要是因为自己太菜了,上学时的那些深度学习知识,已经差不多都还给老师了,而且工程应用又是另一码事。所以我就一边用mmyolo框架训模型,一边从头学起。。。 快成炼丹师了,不过对如何调整hyperparameters一点头绪都没。以下提到的功能的使用,都可以在mmy

YOLOv8的训练和C++部署

写在前面 YOLOv8 是 Ultralytics 公司在 2023 年 1月 10 号开源的 YOLOv5 的下一个重大更新版本,目前支持目标检测,目标分割,物体分类和姿态估计。 很多YOLO介绍blog会附上下面的结构图,虽然99%的人不会去看,而且我也是那99%的其中一员,不过为显专业(啊这该

单目视觉的3D目标方向估计 - Orientation Estimation of 3D Object in Monocular

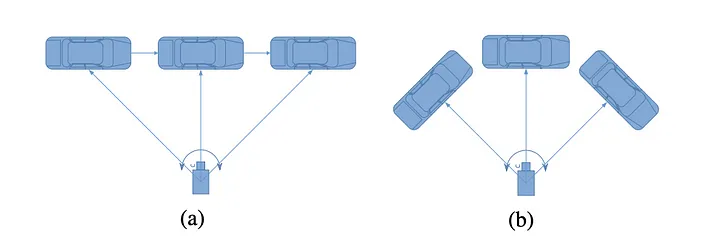

方向的概念 单目相机的3D目标检测是在2D目标检测的基础上绘制出3D BBox任务,目标方向的估计是其中重要一环。 在单目相机3D视觉检测中,要理解一个重要概念:即Egocentric 自我中心和Allocentric 客体中心间的区别。这两个概念来自空间认知领域,Egocentric Frame

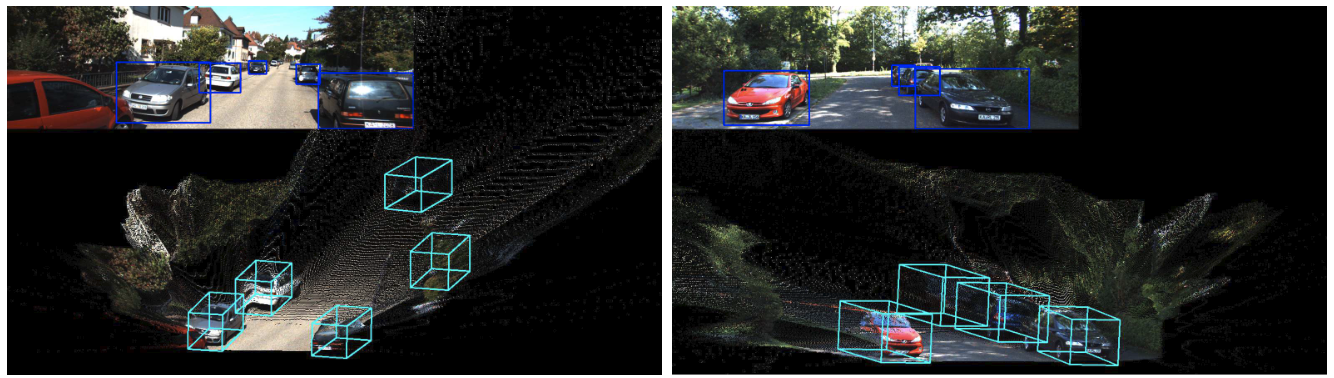

单目相机的3D目标检测 - 3D Object Detection using Monocular

写在前面 即便是完全依靠着CNN检测出的2D bbox可以估计目标的深度,但是后续的预测,规划和运动控制,都需要物体的3D信息。更何况,如果能恢复目标的3D信息,对测距精度的提高也有很大的帮助。 激光雷达和深度相机固然精度很高,但是贵。而且在Lidar和Depth Cam的基础上加入RGB单目相机可

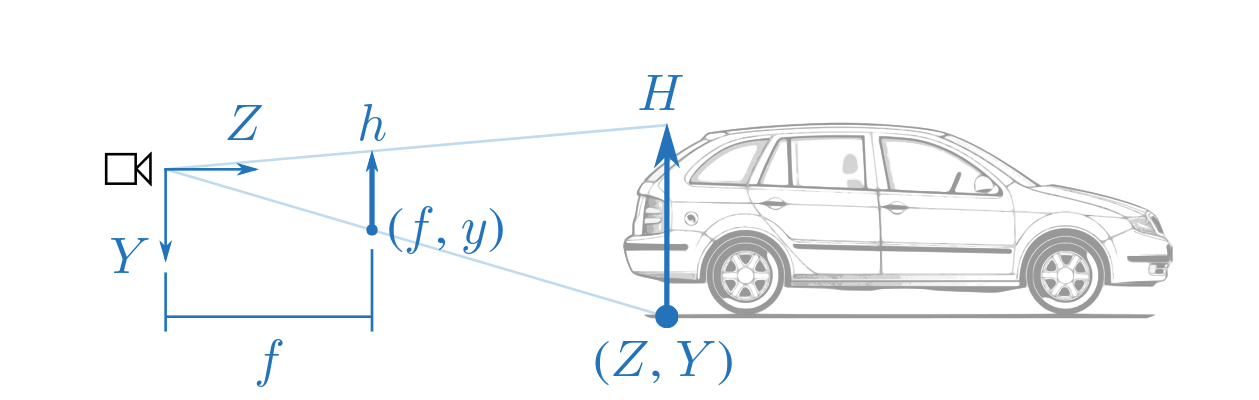

单目相机的测距 - The Distance Estimation of Monocular Camera

写在前面 单目相机测距是怎么回事呢?单目相机相信大家都很熟悉,但是测距是怎么回事呢?下面就让小编带大家一起了解吧。 单目相机测距,其实就是测距了。那么单目相机为什么会测距,相信大家都很好奇是怎么回事。大家可能会感到很惊讶,单目相机怎么会测距呢?但事实就是这样,小编也感到非常惊讶。那么这就是关于单目相

机器学习八股文 - 模型相关

回归 线性回归的四个假设 线性关系:自变量 x 和因变量y之间存在线性关系。 独立性: 残差是独立的。特别是,时间序列数据中的连续残差之间没有相关性。 同方差性: 残差在 x 的每个水平上都有恒定的方差。 正态性: 模型的残差呈正态分布。 误差和残差 误差是观察值与真实值之间的差;残差是观察值与模型

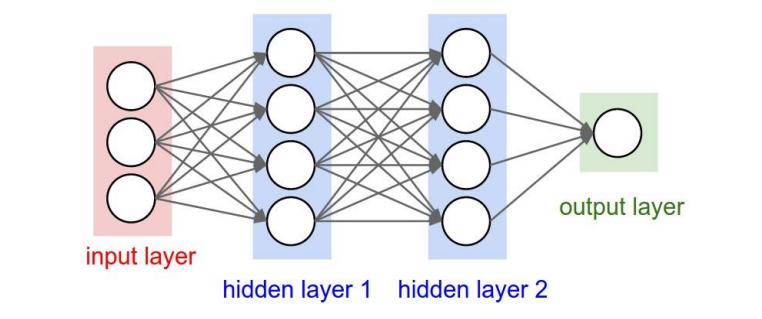

深度学习八股文 - 基础概念

NN中的Bias? 偏置允许激活函数向左或向右移动以更好地适应数据。 反向传播是啥? 允许来自 Cost Function 的信息,从网络末端反向向前传播,以便计算梯度 -> 更新参数。 梯度消失 首先,要知道NN是基于链式法则,因此层数越深,梯度将以指数形式传播。 梯度越来越小,权重值不再产生变化

深度学习 - 卷积神经网络 Convolutional Networks

卷积神经网路 Convolutional Neural Network CNN CNN的结构 卷积层 Convolution 池化层(下采样) Polling 全连接层 Full connection 卷积层 最基础的2D卷积操作,涉及到一个2D的过滤器(filter),或者说是核(kernel)。