多传感器融合——后融合

多传感器融合的方案可以分成前融合(Early Fusion)方案和后融合(Late Fusion)方案。 前融合也叫特征级融合,不同传感器的数据会在特征级别进行合并,也就是说,不同模态的数据经过处理和合并后会得到一个特征集合。一般来说,每个模态数据的特征会被分别提取,然后被提取到的特征会被合并为一个

GStreamer学习

GStreamer在我看来更像是视频编解码领域的内容。 JPEG和MPEG 先区分一下这两个格式[1]。 JPEG全称Joint Photographic Experts Group,文件拓展名一般为.jpg或者.jpeg,是一种静态图像压缩标准,压缩比能达到10:1。 MPEG全称Moving P

计算机视觉中的Affine和Perspective Transformation

Affine Transformation 仿射变换是在二维空间上对图像进行平移(Translation)、缩放(Scale)、旋转(Rotate)、错切(Shear)操作的组合。 四种变换的矩阵形式分别为: 平移:T_t = \begin{bmatrix} 1 & 0 & p_x \\ 0 & 1

【败家】一条手串的的串生历程

虽说是历程...但是手串刚到我的手里,就先放一张出生(无谐音)图吧。 猴头 这个猴头不是黑神话悟空里猴头泡酒的那个猴头...它其实是核桃。 这是一串10mm+的全品小馒头料猴头手串。 柏香籽 也叫百香籽,柏香子,这几种写法都没错。 这是一串36颗的9mm+热振竖桩顺纹柏香籽手串(名字好长),它没法戴

Windows11 4070Ti部署Deepseek

本来以为难度颇高,没想到还挺简单... 需要的软件就两个: ollama Chatbox AI 模型的部署 进入两个软件的官网并下载Windows版本,下载完成后安装。 使用win+R 呼出Windows的终端,然后进入ollama的模型页面,选择你需要使用的模型分支,b前的数字越大,模型参数越多,

C++ STL容器的底层原理

C++ STL 容器是使用频率超高的基础设施,只有了解各个容器的底层原理,才能得心应手地用好不同的容器,做到用最合适的容器干最合适的事情[1]。看了文章[1],可惜其中对容器方法的底层几乎没有提及,那就自己边查边写吧。本文大部分内容来自cplusplus.com/reference/ 。 C++ S

图像的色彩空间

最近一个项目需要用到x86控制器+GMSL相机的组合,这种情况一般会用一张图像采集卡来获取GMSL相机的图像,也就是PCIe-GL26设备将GMSL相机图像发送至HOST端 - FunnyWii's Zone 中使用的方案,但是其成本会很高,于是采购了一个GMSL转USB的转换器。官方也提供了工具的

矩阵乘法

老师教的差不多全还回去了。 向量 向量点积 点积(Dot product)也叫标量积(Scalar product)。在Euclidean空间也称内积(Inner product)。对应元素相乘后相加,结果是一个标量,也就是一个数。 对于向量 a⃗=(

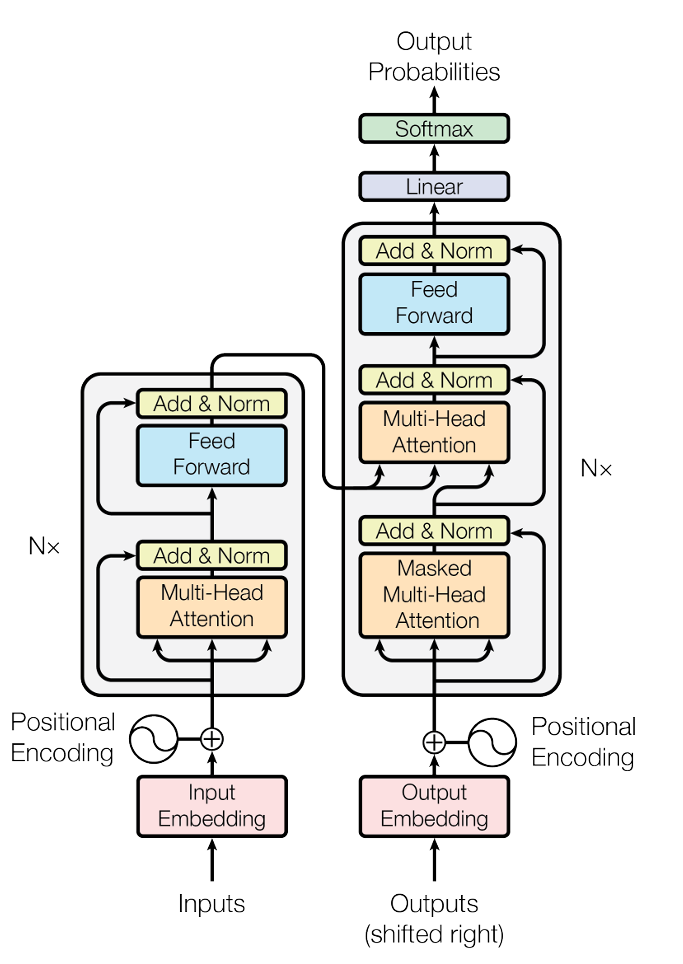

学习Transformer

Transformer在谷歌2017年的论文 [1706.03762] Attention Is All You Need 中首次被提出,主要用于NLP(Natuarl Language Processing,自然语言处理)的各项任务。 后来在CV领域,研究者们基于Transformer架构开展了一

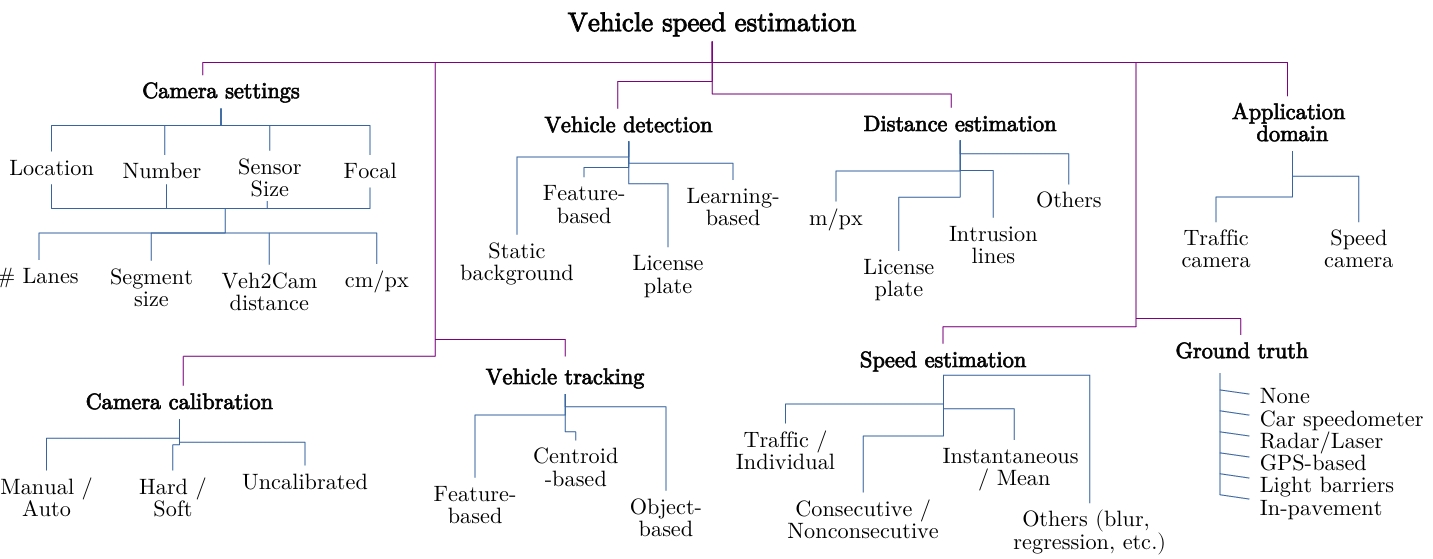

单目相机的相对速度估计

前言 单目相机的目标距离估计本身就已经充满了挑战,那么目标的(相对)速度估计也必然是十分困难... 目前单目相机的相对速度估计算法可以分成两类:传统方法和深度学习方法。没错,什么任务都可以深度学习。 传统方法中,最经典的是Mobileye在2003年的一篇论文中提出的算法。这个算法包含目标距离和速度

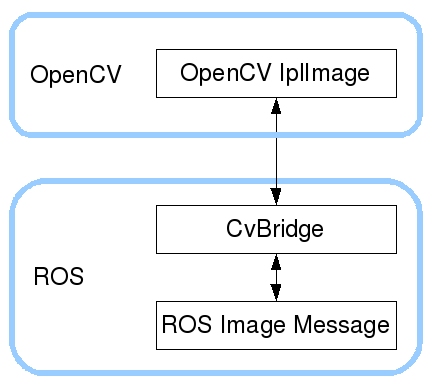

ROS不使用自带OpenCV以及替换cv_bridge

系统:Ubuntu20.04 平台:Jetson Orin NX ROS:ROS2 Foxy OpenCV:4.5.4 with CUDA 问题源自编译时警告: /usr/bin/ld: warning: libopencv_imgcodecs.so.4.2, needed by /opt/ros/

ROS2的消息发布和订阅&图像发布和订阅

ROS2的编译 colcon 是 ROS2 编译的工具。ROS2 的工作空间与 ROS1 保持一样的目录结构: <workspace>

├── build # 编译时自动生成,包含编译的中间文件

├── install # 编译时自动生成,包含编译的结果:可执行文件,库文件,