单目视觉的3D目标方向估计 - Orientation Estimation of 3D Object in Monocular

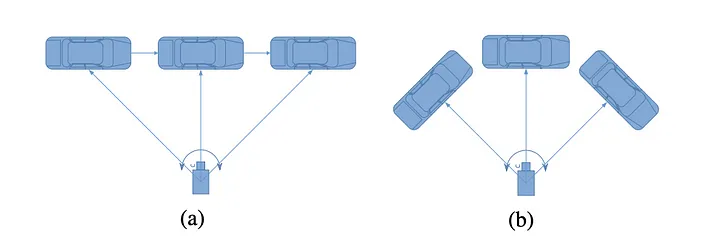

方向的概念 单目相机的3D目标检测是在2D目标检测的基础上绘制出3D BBox任务,目标方向的估计是其中重要一环。 在单目相机3D视觉检测中,要理解一个重要概念:即Egocentric 自我中心和Allocentric 客体中心间的区别。这两个概念来自空间认知领域,Egocentric Frame

单目相机的3D目标检测 - 3D Object Detection using Monocular

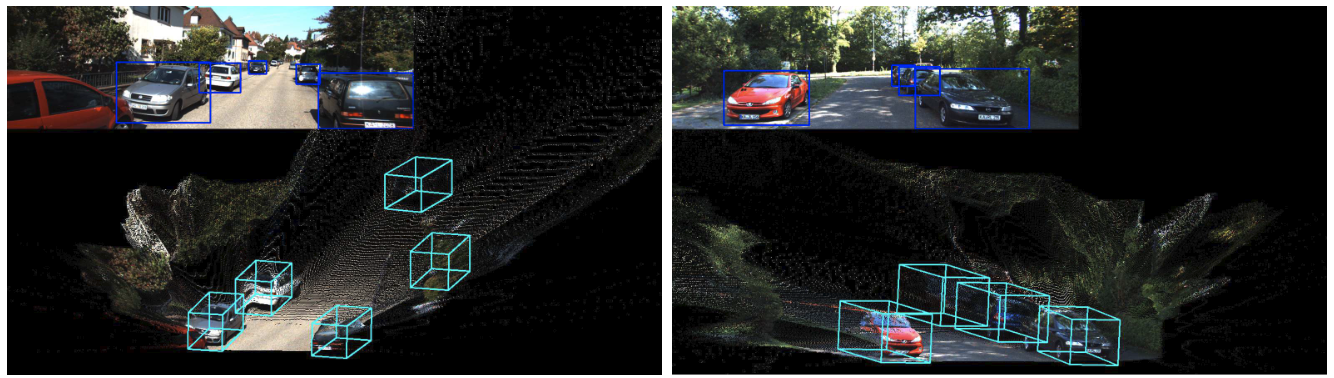

写在前面 即便是完全依靠着CNN检测出的2D bbox可以估计目标的深度,但是后续的预测,规划和运动控制,都需要物体的3D信息。更何况,如果能恢复目标的3D信息,对测距精度的提高也有很大的帮助。 激光雷达和深度相机固然精度很高,但是贵。而且在Lidar和Depth Cam的基础上加入RGB单目相机可

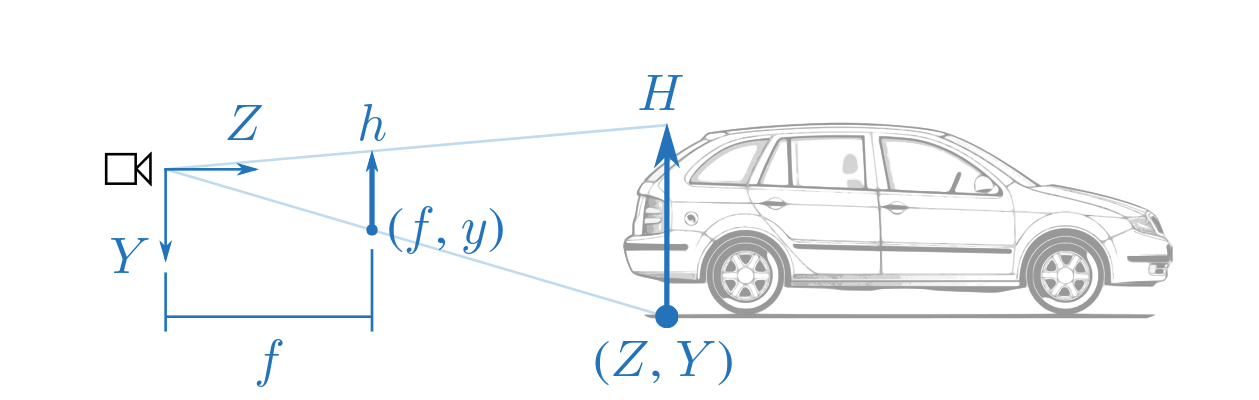

单目相机的测距 - The Distance Estimation of Monocular Camera

写在前面 单目相机测距是怎么回事呢?单目相机相信大家都很熟悉,但是测距是怎么回事呢?下面就让小编带大家一起了解吧。 单目相机测距,其实就是测距了。那么单目相机为什么会测距,相信大家都很好奇是怎么回事。大家可能会感到很惊讶,单目相机怎么会测距呢?但事实就是这样,小编也感到非常惊讶。那么这就是关于单目相

CMakeList.txt 学习笔记

编译程序的时候,在链接库 ADD_LIBRARIES 踩到了大坑。 所以决定重新认真的好好学一下CMakeLists怎么编写。 编写 CMakeLists.txt最常用的功能就是调用其他的.h头文件和.so/.a库文件,将.cpp/.c/.cc文件编译成可执行文件或者新的库文件。 每日一问:领导给买

ROS入门 - 如何订阅数组型消息

每日一问:我学PCL了吗?领导给批显卡了吗? :没有 为什么要订阅数组型消息 比如在这个场景下:YOLO在场景中检测到多个目标,并通过其他算法得到了目标的ID,class,位置,速度等信息。这些信息会作为避障或局部路径规划的依据。一台自动驾驶汽车或机器人上的其他算法模块也可能需要这些信息,这种时候会

ROS入门 - 如何新建功能包 & 如何将现有程序作为功能包加入ROS

写在前面:Ubuntu20.04 对应ROS版本为 Noetic。 每日一问:亲爱的领导什么时候才能让我用PCL和ROS2 并给我配一张显卡捏? 新建ROS工作空间和功能包 创建新的工作空间 # home目录递归创建工作空间,也可以是任何你想创建ws的地方

mkdir -p ~/catkin_ws/

C++函数的参数列表中 & 和 * 的使用

主要区别是函数中形参的三种传递方式,值传递、指针传递和引用传递。

C++实现每隔一段时间,向txt文件中写入数据

使用C++实现每隔一段时间,向一个txt文件中写入一些数据

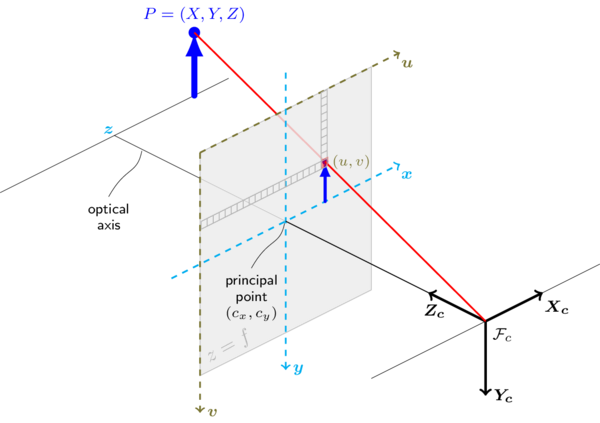

机器视觉 - 单目相机入门

单目相机成像原理 几个概念 光轴:垂直穿过理想透镜中心的光线。 焦点:与光轴平行的光线射入凸透镜时,理想的凸镜应该是所有的光线会聚在透镜后面一点上,这个会聚所有光线的一点,就叫做焦点。 焦距:镜片的中心到焦点为止的光轴上的距离,入射平行光线(或其延长线)与出射会聚光线(或其延长线,在下图中为红色虚线

PCL入门笔记 - PCL 1.13.0 的安装和配置(Ubuntu 20.04 LTS)

介绍了作者是个傻逼这件事。

同时介绍Ubuntu系统下如何安装PCL和VTK,以及它们的测试方法

libstdc++.so.6: version `GLIBCXX_3.4.30' not found 的几个解决思路

写在前面 目前在学习Paddle。在conda环境中使用 pip安装好支持CUDA12.0的Paddle后,import paddle时出现 libstdc++.so.6: version `GLIBCXX_3.4.30' not found这个问题。 根据网上的资料,Paddle编译是使用 gcc

开机自动同步Internet时间(Windows)

目的 在英国读书期间装了个Ubuntu双系统,在这之后,只要开机进入了Ubuntu,再重启回到Windows,系统时间就会变回英国时间,其实这不是什么大问题,但是一些特殊软件需要正确的系统时间(是啥我就不说了),所以每次开机都需要手动同步Internet时间,真tm苦不堪言。 方法 添加一个Wind